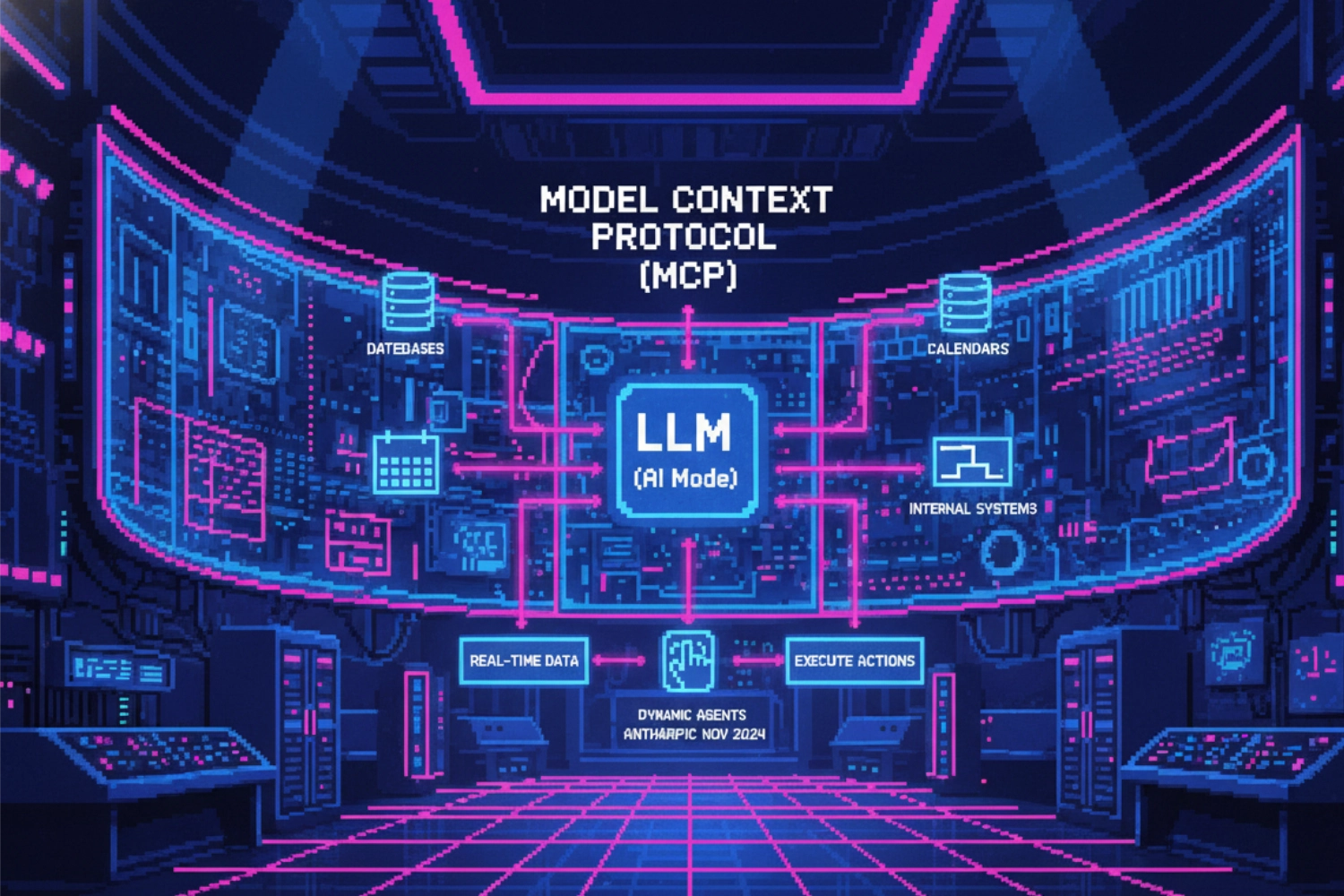

Model Context Protocol (MCP) to otwarty standard, który pozwala modelom sztucznej inteligencji (LLM) łączyć się z zewnętrznymi danymi i narzędziami, takimi jak bazy danych, kalendarze czy wewnętrzne systemy firmowe. Został wprowadzony przez firmę Anthropic w listopadzie 2024 roku. Dzięki MCP modele sztucznej inteligencji nie opierają się już wyłącznie na zamrożonej w czasie wiedzy z danych treningowych. Stają się dynamicznymi agentami, które potrafią pobierać aktualne informacje i wykonywać konkretne akcje.

Co to jest MCP?

Duże modele językowe (LLM) posiadają dwa główne ograniczenia: ich wiedza zatrzymuje się w momencie zakończenia treningu i nie mają one możliwości interakcji ze światem zewnętrznym. MCP rozwiązuje ten problem, działając jako uniwersalny tłumacz pomiędzy aplikacją AI a usługami zewnętrznymi. Zamiast tworzyć dedykowane integracje dla każdej bazy danych czy systemu klasy enterprise, programiści używają ujednoliconego interfejsu MCP.

Protokół ten standaryzuje sposób, w jaki sztuczna inteligencja żąda informacji lub wykonania akcji od innych programów. Eliminuje to tak zwany problem “N x M”, gdzie każda nowa aplikacja AI wymagała budowania oddzielnych połączeń dla każdego zewnętrznego narzędzia. Wspólny standard obniża koszty wdrożeń i przyspiesza tworzenie nowych rozwiązań.

Analogia: uniwersalny tłumacz i walizka z gadżetami Jamesa Bonda

Zasadę działania MCP najłatwiej zrozumieć na przykładzie misji z filmów o Jamesie Bondzie.

- Model LLM (Sztuczna inteligencja): To agent James Bond, który musi rozwiązać problem i wykonać misję.

- Aplikacja AI (np. aplikacja Claude lub Cursor): To postać Q, która przygotowuje odprawę i wręcza agentowi walizkę pełną dostępnych gadżetów.

- Serwery MCP: To ukryty w tle zespół inżynierów, który faktycznie zbudował te gadżety i upewnia się, że działają one w terenie.

Zanim model językowy rozpocznie pracę, aplikacja AI przekazuje mu cel oraz listę dostępnych narzędzi (dostarczanych przez serwery MCP). Model decyduje, którego narzędzia musi użyć do wykonania zadania. Serwery MCP odbierają to żądanie, wykonują fizyczną akcję i zwracają wynik. Bez walizki z narzędziami dostarczonej przez MCP, sztuczna inteligencja pojawiłaby się na misji z pustymi rękami.

Dlaczego modele AI potrzebują serwerów MCP?

Aplikacje takie jak ChatGPT czy Claude nie mogą samodzielnie stać się uniwersalnymi narzędziami do wszystkiego. Duże modele językowe (LLM) posiadają wiedzę zamrożoną w czasie i nie potrafią wejść w interakcję ze światem zewnętrznym. Potrzebują serwerów MCP z trzech głównych powodów.

Po pierwsze, modele muszą wykonywać konkretne akcje. Zwykły czatbot nie potrafi samodzielnie złożyć zamówienia ani zaktualizować statusu zadania w systemie CRM. Po drugie, sztuczna inteligencja wymaga bezpiecznego dostępu do prywatnych baz danych. Obejmuje to odczytywanie historii zamówień, analizę wewnętrznych dokumentów czy przeszukiwanie skrzynek e-mailowych. Po trzecie, użytkownicy szukają specyficznych, precyzyjnych informacji. Model AI generuje odpowiedzi bazujące na średniej ze swoich danych treningowych, podczas gdy pracownik potrzebuje dokładnych liczb z najnowszego raportu finansowego.

W przeszłości programiści musieli pisać dedykowany kod integrujący każdy model AI z każdym nowym narzędziem. Tworzyło to ogromne koszty i problemy z utrzymaniem infrastruktury. Standard MCP eliminuje ten problem. Tworzy on ujednolicone połączenie, które pozwala różnym aplikacjom AI bezpiecznie i szybko korzystać z zewnętrznych usług bez pisania niestandardowych integracji.

Jak działają serwery MCP w praktyce?

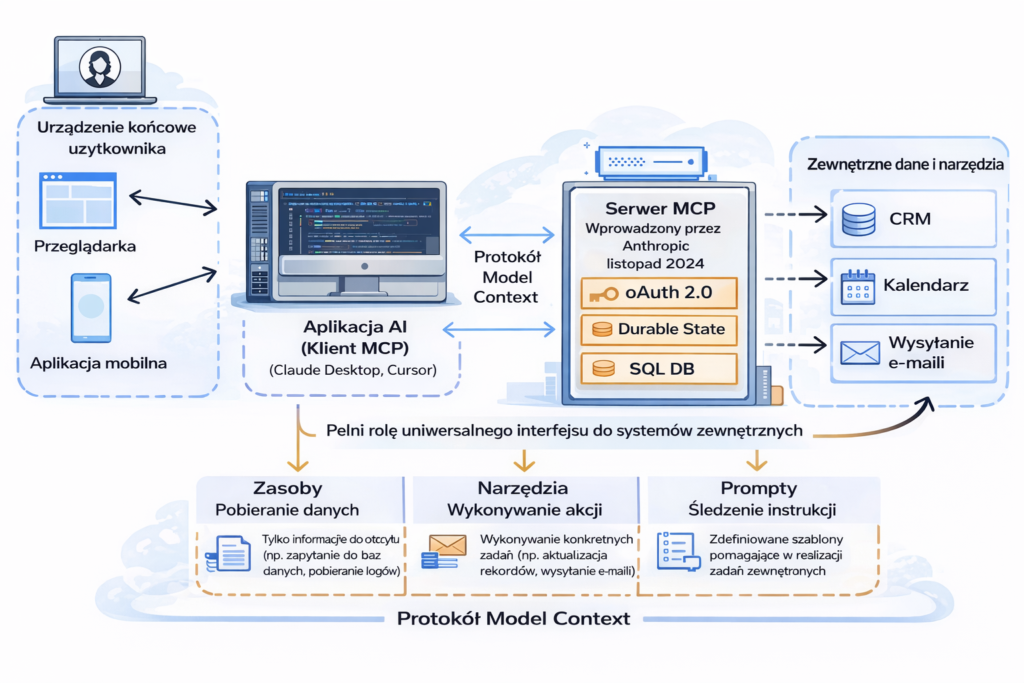

Architektura Model Context Protocol opiera się na wyraźnym podziale obowiązków. System składa się z trzech głównych elementów, które współpracują ze sobą podczas każdego zapytania użytkownika.

- Host (Aplikacja AI): To program, z którym bezpośrednio rozmawia użytkownik (np. asystent Claude Desktop lub edytor kodu Cursor). Host interpretuje polecenie i decyduje, czy potrzebuje pomocy zewnętrznego systemu.

- Klient MCP: Znajduje się wewnątrz aplikacji AI (Hosta). Klient odpowiada za nawiązywanie i utrzymywanie połączenia oraz tłumaczenie żądań sztucznej inteligencji na format zrozumiały dla serwera.

- Serwer MCP: To zewnętrzna usługa, która udostępnia dane lub potrafi wykonać konkretną akcję. Serwer łączy się z systemami docelowymi (np. Slack, GitHub, lokalne pliki), przetwarza zapytanie i zwraca gotowy wynik do klienta.

Serwery MCP oferują sztucznej inteligencji trzy precyzyjne rodzaje możliwości (capabilities):

- Zasoby (Resources): Informacje tylko do odczytu. Serwer może udostępnić treść konkretnego pliku, listę logów systemowych lub dane z bazy klientów. Zasoby mają charakter pasywny i nie zmieniają stanu systemu zewnętrznego.

- Narzędzia (Tools): Aktywne operacje, które wykonują konkretne zadania. Narzędzia pozwalają modelowi AI wysłać wiadomość e-mail, utworzyć nowe wydarzenie w kalendarzu lub zaktualizować rekord w bazie danych. Wymagają one często wyraźnej zgody użytkownika na wykonanie akcji.

- Prompty: Gotowe szablony poleceń. Pomagają one sztucznej inteligencji krok po kroku zrealizować skomplikowany proces i ustandaryzować sposób, w jaki aplikacja AI komunikuje się z serwerem.

Co użytkownik może (a czego nie może) zrobić z pomocą MCP?

Serwery MCP dają sztucznej inteligencji ogromne możliwości, ale posiadają też twarde ograniczenia techniczne. Użytkownik nigdy nie komunikuje się z serwerem MCP bezpośrednio. Cała interakcja odbywa się zawsze za pośrednictwem aplikacji AI (np. Claude lub Cursor).

Co możesz zrobić za pomocą MCP:

- Komunikacja: Możesz poprosić AI o wysłanie e-maila, napisanie wiadomości na Slacku lub utworzenie wydarzenia w kalendarzu.

- Przeszukiwanie danych: Model AI może odczytać zawartość pliku, przeszukać bazę klientów lub pobrać najnowsze wyniki sprzedaży.

- Zarządzanie treścią: Możesz zlecić AI stworzenie nowego dokumentu, zaktualizowanie statusu zadania w zewnętrznym systemie lub wygenerowanie raportu.

Czego NIE możesz zrobić (Główne ograniczenia):

- Bezpośrednie wgrywanie plików (Upload): Standardowy protokół nie pozwala na “upuszczenie” pliku PDF lub obrazu bezpośrednio na serwer MCP. Musisz podać sztucznej inteligencji link (URL) lub ścieżkę do pliku zapisanego na dysku.

- Nieskończone operacje: Serwery MCP posiadają ścisłe limity czasu (zazwyczaj od 30 sekund do 5 minut). Nie możesz zlecić AI monitorowania strony internetowej przez 24 godziny na dobę.

- Pobieranie całych baz danych: Odpowiedzi serwera mają limity wielkości. Zamiast prosić o dane “wszystkich klientów”, musisz poprosić o konkretny wycinek, np. “10 najnowszych klientów”.

- Brak pamięci po rozłączeniu: Jeśli aplikacja AI rozłączy się z serwerem, sesja wygasa i traci ona kontekst poprzedniej rozmowy, choć są na to rozwiązania, które stosujemy podczas projektowania wtyczek do AI dla naszych klientów.

MCP a RAG – jaka jest różnica?

Zarówno Model Context Protocol (MCP), jak i technika Retrieval-Augmented Generation (RAG) dostarczają modelom LLM zewnętrznych informacji. Robią to jednak w zupełnie inny sposób i służą do różnych celów.

| Cecha | Model Context Protocol (MCP) | Retrieval-Augmented Generation (RAG) |

| Główny cel | Standaryzacja dwukierunkowej komunikacji. Pozwala AI na interakcję i wykonywanie akcji w systemach zewnętrznych. | Wzbogacenie odpowiedzi LLM poprzez pobranie informacji z bazy wiedzy przed wygenerowaniem tekstu. |

| Sposób działania | Model AI wywołuje zewnętrzne funkcje (Tools) lub prosi o ustrukturyzowane dane z dedykowanych serwerów. | System pasywnie wyszukuje fragmenty tekstu pasujące do zapytania użytkownika i dodaje je do promptu. |

| Wynik | Sztuczna inteligencja wykonuje akcje (np. rezerwuje lot, aktualizuje system CRM) i zwraca wynik operacji. | Sztuczna inteligencja generuje odpowiedź tekstową opartą wyłącznie na faktach z dostarczonych dokumentów. |

FAQ: Najczęściej zadawane pytania o Model Context Protocol

Czy korzystanie z serwerów MCP jest bezpieczne dla moich prywatnych danych?

Tak, ale wymaga to świadomej kontroli ze strony użytkownika. Użytkownik musi wyraźnie zezwolić aplikacji AI na dostęp do serwera MCP (np. poprzez proces logowania OAuth). Należy uważnie sprawdzać uprawnienia, ponieważ po ich przyznaniu sztuczna inteligencja może odczytywać dane i wykonywać akcje w Twoim imieniu. Zawsze stosuj zasadę minimalnych przywilejów.

Czy mogę bezpośrednio wgrać plik na serwer MCP?

Nie, protokół MCP nie obsługuje bezpośredniego wgrywania plików ani przeciągania ich do okna czatu w celu przesłania na serwer. Aby AI mogło przeanalizować plik, musisz najpierw umieścić go na dysku w chmurze lub dysku lokalnym, a następnie podać sztucznej inteligencji sam link (URL) lub ścieżkę dostępu.

Jakie aplikacje AI obsługują obecnie protokół MCP?

Do najpopularniejszych aplikacji (Hostów MCP) obsługujących ten standard należą obecnie m.in.: Claude Desktop, Cursor (edytor kodu), ChatGPT oraz Windsurf Editor. Lista ta stale rośnie, a z czasem protokół zostanie wdrożony w większości narzędzi deweloperskich i biznesowych.

MCP w skrócie na infografice